-

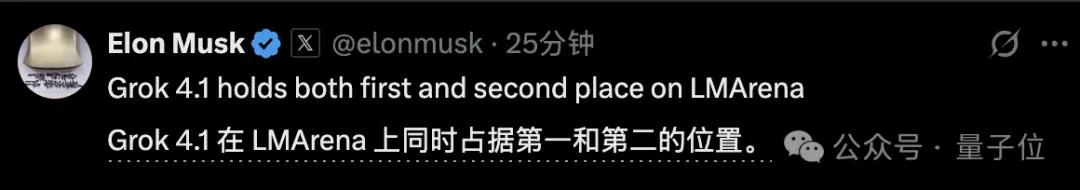

马斯克悄然发布 Grok 4.1,霸榜大模型竞技场所有排行榜

文章报道了 xAI 公司最新发布的大语言模型 Grok 4.1。该模型在多个大模型竞技场排行榜上表现出色,其“思考模式”和“非思考模式”均位列前茅,并在专家榜和职业榜的多个细分领域中占据主导地位。需要注意的是,目前部分榜单的投票数仍处于初步阶段(“Preliminary”标记),但 Grok 4.1 的进步已获用户认可,盲测显示 64.78%的用户更喜欢新版。Grok 4.1 在情感响应、创意写作…- 0

- 0

-

万字长文:大语言模型复杂推理的自我进化机制

文章深入探讨了大语言模型在复杂推理方面的研究进展,并从自我进化的视角构建了一个系统性的研究框架。该框架主要由数据进化、模型进化和自我进化三个相互关联的部分组成,为理解和提升 LLM 的复杂推理能力提供了一个统一的视角。数据进化侧重于改进推理训练数据,包括任务进化和增强思维链推理。模型进化则通过在训练过程中优化模型模块来增强复杂推理能力。自我进化部分探讨了 LLM 的进化策略和模式,包括自我进化的规…- 0

- 0

-

121. 对 DeepMind 谭捷的访谈:机器人、跨本体、世界模型、Gemini Robotics 1.5 和 Google

本期播客深入访谈了 Google DeepMind 高级研究科学家谭捷,聚焦机器人技术的前沿发展。谭捷分享了其从计算机图形学转型机器人研究的经历,强调了强化学习和大语言模型对机器人领域的革命性影响。他指出,大语言模型赋予机器人理解语言和常识的能力,而强化学习则擅长底层运动控制,二者结合构建了机器人的“大脑”与“小脑”。播客详细介绍了 DeepMind 的 Gemini Robotics 1.5 项…- 0

- 0

-

狂揽 23.9k stars!超棒的开源 LLM 资源列表

本文系统整理了当前最全面的开源大型语言模型(LLM)资源列表,该资源库在 GitHub 上获得 23.9k 星标。内容涵盖多个知名开源项目如 DeepSeek、Qwen 等中英文模型,以及训练框架(如 DeepSpeed、Megatron-LM)、推理工具(如 vLLM、llama.cpp)、评估方法、应用开发库(LangChain、LlamaIndex)等。资源按技术领域分类,覆盖 LLM 全生…- 0

- 0

-

万字长文讲透 LLM 核心:Transformer 架构原理解析

文章全面且深入地剖析了作为大型语言模型(LLM)基石的 Transformer 架构。从基础概念入手,详细讲解了文本如何通过分词、词嵌入和位置编码转化为模型可处理的数字表示。核心部分聚焦于注意力机制,包括自注意力、多头注意力和因果注意力,阐释了模型如何捕捉词语间的复杂依赖关系,并有效解决了传统 RNN 在处理长文本时面临的长距离依赖和并行计算等问题和挑战。此外,文章还介绍了前馈神经网络(FFN/M…- 0

- 0

-

大神 Andrej 的最新 AI 课: 大语言模型 LLM 深入详解 | 5 万字完整版·附视频

本文是 Web3 天空之城整理的 Andrej Karpathy 关于大语言模型 (LLM) 的 3.5 小时讲座的 5 万字全文。讲座深入探讨了 ChatGPT 等 LLM 的技术原理,涵盖了模型开发的完整训练流程,以及如何理解其“心理模型”,并如何在实际应用中最好地利用它们。内容包括:预训练阶段的数据处理、分词 (Tokenization)、Transformer 神经网络训练,推理阶段的生成…- 0

- 0

-

AI 应用:浮现中的 AI 经济 | 机器之心

文章从人类经济活动的数字化进程出发,阐述了计算机和互联网时代如何提升了匹配效率。随后,重点分析了 AI,特别是大语言模型出现后,如何使计算能力具备泛化交付工作能力,并在 2025 年达到超越人类的临界点。作者提出了 AI 经济的六大特征:全天候自动运行、无劳动力供给限制、迈向非稀缺经济、交易成本显著降低、非理性决策减少,以及人类能够“向历史求解”以寻求“时空最优解”。文章展望了 AI 如何促进人的…- 0

- 0

-

周志华团队新作:LLM 中存在奖励模型,首次理论证明 RL 对 LLM 有效性 | 机器之心

该研究首次从理论上证明了大语言模型(LLMs)内部存在内源性奖励机制,无需依赖昂贵的人类标注数据或外部 AI 反馈。研究团队展示了如何从标准的下一个 Token 预测目标中恢复出离线逆强化学习奖励函数,并通过数学证明使用这种内源性奖励进行微调可以使策略误差界限从 O(H²)改进到 O(H),显著优于基线模型。实验通过三个核心问题验证:1)内源性奖励模型(EndoRM)在多样偏好对上超越显式训练模型…- 0

- 0

-

GLM-4.5 技术博客:原生融合推理、编码和智能体能力

文章详细介绍了智谱最新发布的旗舰大语言模型 GLM-4.5 和 GLM-4.5-Air,旨在将复杂的推理、强大的编程和高级智能体能力统一于一个模型。GLM-4.5 拥有 3550 亿总参数,GLM-4.5-Air 拥有 1060 亿总参数,两者均采用混合推理模式。文章展示了 GLM-4.5 在智能体任务(如网页浏览)、复杂推理(数学、科学、逻辑)和编程(代码构建、Agentic 编程)等 12 个…- 0

- 0

-

从 Prompt 到 Context:基于 1400+ 论文的 Context Engineering 系统综述

基于对 1400 多篇论文的系统综述,文章深入探讨了“Context Engineering”这一新兴概念,指出其是 Prompt Engineering 的延伸,旨在通过在有限的上下文窗口内精确构建信息,以优化大型语言模型(LLM)的行为。作者首先通过类比搜索引擎的历史,反驳了 Prompt Engineering 将被弱化的观点,并引入了 Context Engineering。文章将 LLM…- 0

- 0

-

Ling-1T,智渊、思简

文章详细介绍了 Ling Team 推出的 Ling-1T 大模型,这是一款基于 Ling 2.0 架构的万亿参数开源旗舰非思考模型。该模型在复杂推理、代码生成、前端开发和跨领域泛化等任务上均达到 SOTA 水平,实现了高效推理与精准输出的平衡。Ling-1T 支持最高 128K 上下文窗口,通过“中训练+后训练”的演进式思维链(Evo-CoT)提升推理能力。在训练方面,Ling-1T 是已知规模…- 0

- 0

-

全新 MoE 架构!阿里开源 Qwen3-Next,训练成本直降 9 成 | 机器之心

文章详细介绍了阿里通义团队开源的下一代大语言模型架构 Qwen3-Next。该模型总参数 80B,但仅激活 3B 参数,实现了训练成本直降 9 成、推理吞吐提升 10 倍以上的突破。其核心创新包括:结合 Gated DeltaNet 和 Gated Attention 的混合注意力机制,旨在优化长上下文处理;采用 512 个专家、10 个路由专家和 1 个共享专家的极致稀疏 MoE 结构,仅激活 …- 0

- 0

-

3 万字长文!通俗解析大语言模型 LLM 原理

文章深度剖析了大语言模型(LLM)的演进历程与核心原理。开篇回顾了从 N-gram 到 RNN、LSTM 等统计与神经网络语言模型的发展及其局限性。随后,详细阐述了 Transformer 架构,包括其 Encoder-Decoder 结构、多头注意力机制、位置前馈网络、残差连接与层归一化,并重点介绍了其并行计算优势。文章进一步聚焦于现代 LLM 普遍采用的 Decoder-Only 架构,解释了…- 0

- 0

-

深度讨论 Gemini 3 :Google 王者回归,LLM 新一轮排位赛猜想|Best Ideas

文章深度剖析了 Google Gemini 3 的发布及其对大模型竞争格局的重塑。文章指出,Gemini 3 在预训练算力上首次追平 OpenAI,并凭借 Google 独特的数据、稀疏化 MoE 架构及 TPU 软硬协同,实现多维度突破。它详细对比了 Google、OpenAI、Anthropic 三家在大模型能力、成本及策略上的差异,并引用 XBench 测评数据,凸显 Gemini 3 在智…- 2

- 0

大语言模型

❯

个人中心

购物车

优惠劵

今日签到

有新私信

私信列表

搜索

扫码打开当前页

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

✈优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!