-

AI 安全危机迫在眉睫(及应对之策)| 桑德·舒尔霍夫

桑德·舒尔霍夫在莱尼播客中深入探讨了 AI 安全中的关键漏洞,例如提示注入和越狱。他认为,广泛采用的防御机制,如 AI 护栏和自动化红队测试,在面对坚决的攻击者时大多无效。舒尔霍夫强调,AI 安全与传统的网络安全有着根本性的区别,因为 AI 模型容易受到难以修补的攻击。讨论强调了随着 AI 智能体获得更多自主权和广泛采用,风险正在升级,这可能导致数据泄露、经济损失,甚至是物理伤害。他敦促组织重新评…- 0

- 0

-

漏洞百出的夏季:聚焦约翰·雷贝格的提示注入研究

本文报道了独立 AI 研究员约翰·雷贝格发起的“AI 漏洞月”倡议,他每天发布关于各种易受提示注入攻击的 AI 工具的报告。该研究涵盖多个平台,如 ChatGPT、Codex、Anthropic MCPs、Cursor、Amp、Devin、OpenHands、Claude Code、GitHub Copilot 和 Google Jules 等,揭示了这些漏洞在发现三年后仍然普遍且危险。作者总结了…- 0

- 0

-

保护 VS Code 免受提示注入攻击

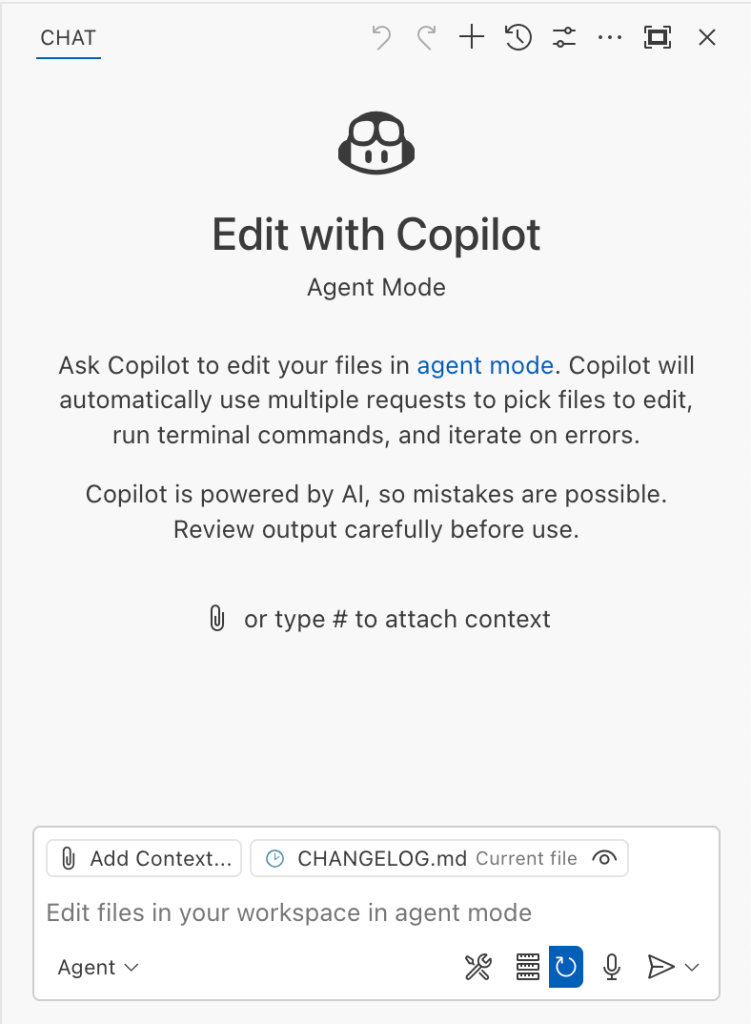

本文探讨了 VS Code 的 Copilot Chat 代理模式中发现的关键提示注入漏洞。该模式集成了大型语言模型 (LLM) 与本地开发环境和各种工具。代理的内部机制将工具输出和用户提示混合,形成单一的输入供 LLM 处理,但这种混合可能被恶意利用。LLM 可能将外部数据(如 GitHub 问题中的恶意指令)错误地解释为命令,而非单纯的信息。文中详细描述了三个主要漏洞:`fetch_webpa…- 0

- 0

提示注入

❯

个人中心

购物车

优惠劵

今日签到

有新私信

私信列表

搜索

扫码打开当前页

返回顶部

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

✈优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!