本文介绍了通义千问的两项重大更新:一是开源了 Qwen3-TTS 全家桶,包含 1.7B 和 0.6B 两个版本,支持 3 秒音色克隆、自然语言控制音色及 10 种语言合成,端到端延迟低至 97ms。二是上线了 Qwen3-Max-Thinking 大模型,该模型通过自适应工具调用和测试时扩展技术(TTS),在复杂推理、事实知识等维度表现卓越,多项基准测试成绩媲美 GPT-5.2 等顶尖模型,并已通过 API 和 Qwen Chat 开放使用。

Qwen3-TTS全家桶开源

你的声音,你做主!

通义千问正式开源 Qwen3-TTS 全系列语音合成模型,全面支持音色克隆、音色创造、超高质量拟人化语音生成,以及基于自然语言描述的语音控制,为你提供最全面的语音生成功能。本次开源了两个版本:1.7B (极致性能)、0.6B(轻量高效),满足从云端到边缘的多样化部署需求。

Qwen3-TTS 核心亮点

✅ 3秒克隆你的声音

✅ 自然语言描述你想要的音色(比如“暴躁川普大叔”或“撒娇萝莉音”)

✅ 端到端合成延迟低至 97ms

✅ 10种语言(中、英、日、韩、德、法、俄、葡萄牙、西班牙、意大利)+ 9个精品音色

✅ 拼音、数学公式、表情符号都能读

音色控制

指令控制

性别: 女性声音;

音高: 女性中高音区,语调富于变化;

语速: 语速明快,偶有加速;

音量: 正常交谈音量,笑声响亮;

清晰度: 吐字清晰,发音标准;

流畅度: 表达流畅自如;

口音: 普通话;

音色质感: 音色明亮,略带爽朗;

情绪: 愉悦友好,伴随爽朗笑意;

语调: 语调上扬活泼,疑问时尤为明显;

性格: 外向开朗,热情健谈。

指令控制:以极度悲伤、带着明显哭腔的语气,用较小的音量缓缓诉说,语速缓慢,仿佛每一个字都承载着沉重的痛楚,声音颤抖而压抑,吐字虽轻却清晰可辨,透出深藏心底的哀伤与无助。

指令控制:保持青年女性的声线特征,展现出一种清亮且略具紧迫感的音色,语速从平稳开始在叙述过程中逐渐加快,音量在情绪波动时增加,语调在句末调高以强调劝告的语气。

音色创造

指令控制:采用高亢的男性嗓音,语调随兴奋情绪不断上扬,以快速而充满活力的节奏传达信息。音量要足够响亮,近乎喊叫,以体现紧迫感。发音务必清晰精准、字字分明,让每个词都铿锵有力。整体表达需流畅自然、明亮生动,富有戏剧性,展现出外向、自信且张扬的个性,同时传递出一种威严而宏大的宣告语气,洋溢着满溢的激动之情。

音色克隆

多样音色与精准控制背后,是 Qwen3-TTS 一系列坚实的技术支撑。

-

自研 Qwen3-TTS-Tokenizer-12Hz,它能对声音进行高效编码,完整保留情感、气息等细节,并实现高保真还原,这是音色高相似度与丰富表现力的基础。

-

通用的端到端架构,它简化了从文本到语音的生成路径,规避了传统方案的信息损失,从而提升了整体生成效率与效果上限。

-

创新 Dual-Track 流式生成架构,它实现了边输入边播放的实时体验,端到端延迟低至 97ms,让交互如对话般自然流畅。

-

深度语义理解与指令控制能力,使模型不仅能读懂文字,更能理解情感与意图,从而通过自然语言指令灵活调控音色、语调与节奏,实现“所想即所听”。

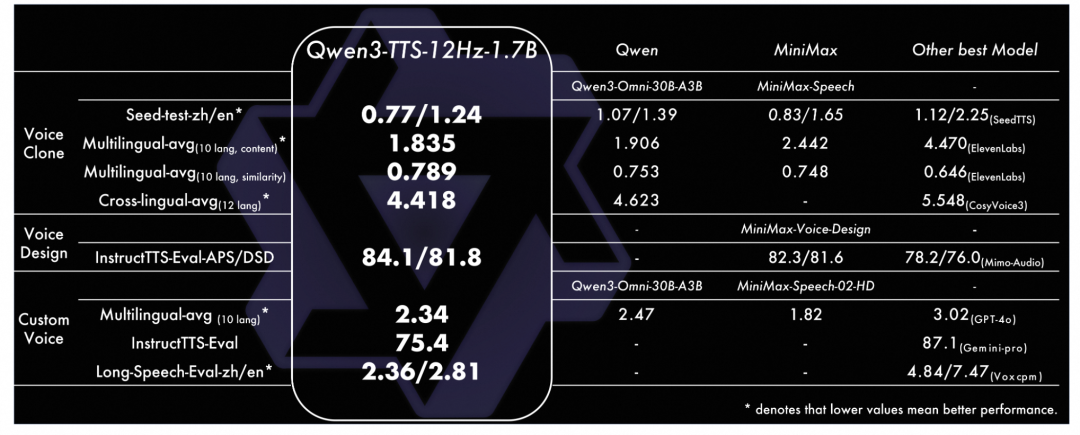

综合多项评测,Qwen3-TTS 在音色创造、音色控制与音色克隆任务上均展现出领先的性能。其表现整体超越对应闭源模型,并在跨语种克隆等任务上达到当前最优水准。

GitHub:https://github.com/QwenLM/Qwen3-TTS

API:https://help.aliyun.com/zh/model-studio/qwen-tts-realtime

Qwen3-Max(Thinking)上线

更会“思考”的大模型来了!

去年9月份,我们发布了 Qwen3-Max-Preview。今天,我们正式推出 Qwen3-Max-Thinking。

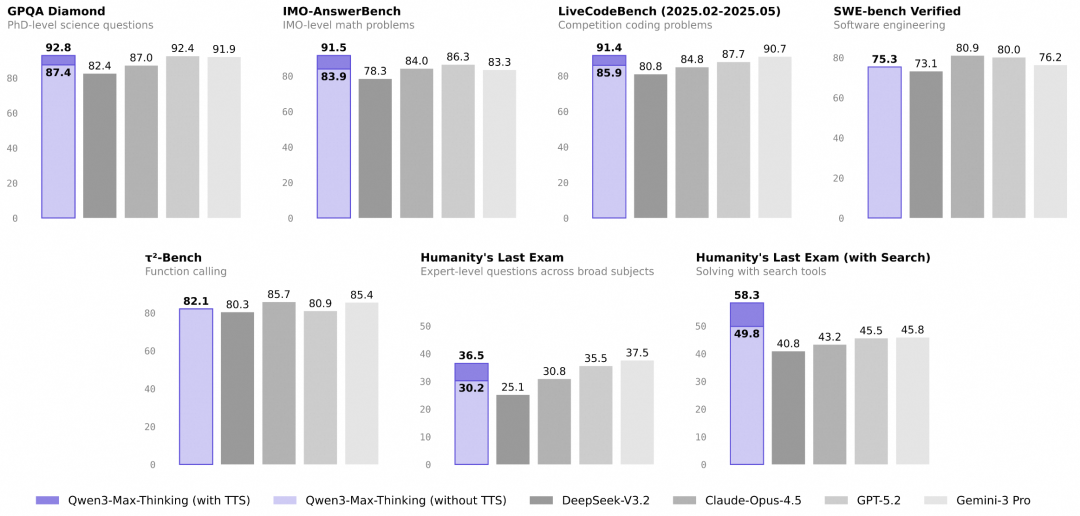

通过大幅增加模型规模并强化训练,它在事实知识、复杂推理、指令遵循、人类偏好对齐以及智能体能力五大维度全面跃升,在 19 项权威基准测试中,其性能已可媲美当前顶尖大模型,如 GPT-5.2-Thinking-xhigh、Claude Opus 4.5 和 Gemini 3 Pro。

更重要的是,Qwen3-Max-Thinking 引入了两大核心创新:

1、自适应工具调用能力:在对话中过程中 Qwen3-Max-Thinking 能根据用户需求,智能判断何时调用搜索引擎或代码解释器,自动为你获取实时信息、执行计算或调取历史上下文。这一能力已在 Qwen Chat 上线,欢迎体验。

2、测试时扩展技术(TTS):我们提出一种经验累积式、多轮迭代的推理策略。模型在推理过程中不断从自身过往步骤中提炼关键洞见,避免重复推导,聚焦未解问题。

在相同 token 消耗下,该技术显著提升推理质量。面对越难的问题,Qwen3-Max-Thinking 越能“沉住气”,通过自我反思一步步逼近正确答案。

以下是 Qwen3-Max-Thinking(with TTS),在多项权威基准上的表现对比:

-

GPQA Diamond:87.4 → 92.8

-

IMO-AnswerBench:83.9 → 91.5

-

LiveCodeBench v6:85.9 → 91.4

-

Humanity's Last Exam:49.8 → 58.3(工具调用场景下的绝对领先)

目前,Qwen3-Max-Thinking 已上线 Qwen Chat,并开放 API(阿里云百炼👉模型名:qwen3-max-2026-01-23)。

由于 Qwen 系列 API 兼容 OpenAI API 协议,你可以沿用调用 OpenAI API 的通用方式。以下是在 Python 中调用 Qwen3-Max-Thinking 的示例:

from openai import OpenAIimport osclient = OpenAI(api_key=os.getenv("API_KEY"),base_url="https://dashscope.aliyuncs.com/compatible-mode/v1",)completion = client.chat.completions.create(model="qwen3-max-2026-01-23",messages=[{"role": "user", "content": "Give me a short introduction to large language model."}],extra_body={"enable_thinking": True})print(completion.choices[0].message)

Qwen Chat:https://chat.qwen.ai/

API:https://bailian.console.aliyun.com/cn-beijing/?tab=model#/model-market/detail/qwen3-max-2026-01-23

如果你在模型使用过程中遇到问题、有功能建议,或发现了惊艳的用法,欢迎在评论区留言。优质留言有机会被翻牌 + 送小彩蛋哦~